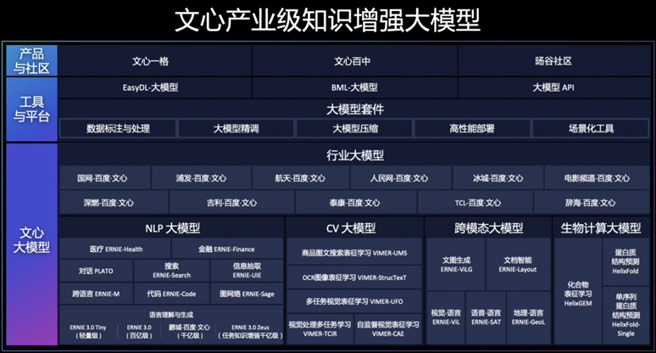

第一層是基礎(chǔ)層:也就是由“預(yù)訓(xùn)練模型”為基礎(chǔ)而搭建的AIGC技術(shù)基礎(chǔ)設(shè)施層。由于“預(yù)訓(xùn)練模型”的高成本和技術(shù)投入,具有較高的進(jìn)入門檻,需要分布式大模型作為基礎(chǔ)算力框架。以2020年5月推出的推測(cè)訓(xùn)練GPT-3為例,其一個(gè)訓(xùn)練計(jì)算周期的成本可能接近1200萬美元。因此目前進(jìn)入預(yù)訓(xùn)練模型的主要機(jī)構(gòu)為領(lǐng)域頭部賽道企業(yè)、超大型院校科研機(jī)構(gòu)等。國(guó)內(nèi)影響力較強(qiáng)的就是即將在3月發(fā)布的文心大模型。2022年上半年,百度升級(jí)了任務(wù)相關(guān)知識(shí)增強(qiáng)的千億大模型文心ERNIE 3.0 Zeus。這個(gè)模型除了進(jìn)行無標(biāo)注數(shù)據(jù)和知識(shí)圖譜的學(xué)習(xí)外,還通過持續(xù)學(xué)習(xí)算法對(duì)百余種不同形式的任務(wù)進(jìn)行學(xué)習(xí),以實(shí)現(xiàn)任務(wù)知識(shí)的增強(qiáng)。因?yàn)橛辛嘶A(chǔ)層大模型的技術(shù)支撐,下游行業(yè)才能如雨后春筍般發(fā)展,形成了目前的AIGC商業(yè)洪流。

第二層是中間層:即垂直化,場(chǎng)景化、個(gè)性化的模型和應(yīng)用工具。預(yù)訓(xùn)練的大模型是基礎(chǔ)設(shè)施,在此基礎(chǔ)上可以快速抽取生成場(chǎng)景化、定制化、個(gè)性化的小模型,實(shí)現(xiàn)在不同行業(yè)、重直領(lǐng)域,功能場(chǎng)景的工業(yè)流水線式部署,同時(shí)兼具按需使用,高效經(jīng)濟(jì)的優(yōu)勢(shì)。2022年6月,文心大模型中的輕量化技術(shù)加持的多個(gè)文心ERNIE 3.0 Tiny輕量級(jí)模型開源至飛槳自然語言處理模型庫PaddleNLP中,直接通過在線蒸餾技術(shù)將預(yù)訓(xùn)練大模型壓縮成預(yù)訓(xùn)練小模型。該模型刷新了中文小模型的SOTA成績(jī)。

隨著兼具大模型和多模態(tài)模型的AIGC模型加速成為新的技術(shù)平臺(tái),模型即服務(wù)(Model-as-a-Service MaaS)開始成為現(xiàn)實(shí),預(yù)計(jì)將對(duì)商業(yè)領(lǐng)域產(chǎn)生巨大影響。

第三層是應(yīng)用層:即面向C端用戶的文字、圖片、音視頻等內(nèi)容生成服務(wù)。在應(yīng)用層側(cè)重滿足用戶的需求,將AIGC模型和用戶的需求無縫銜接起來實(shí)現(xiàn)垂直落地。應(yīng)用層開放的不僅僅是程序,還有其已經(jīng)訓(xùn)練好的模型,后繼創(chuàng)業(yè)者能更好的借助這一開源工具,以C端消費(fèi)級(jí)顯卡的算力門檻,挖掘出更豐富的內(nèi)容生態(tài),為AIGC在更廣泛的C端用戶中的普及起到至關(guān)重要的作用。現(xiàn)在貼近C端用戶的工具越發(fā)豐富多樣,包括網(wǎng)頁,本地安裝的程序,移動(dòng)端小程序,群聊機(jī)器人等,甚至還有利用AIGC工具定制代出圖的內(nèi)容消費(fèi)服務(wù)。

隨著數(shù)字技術(shù)與實(shí)體經(jīng)濟(jì)融合程度不斷加深,以及互聯(lián)網(wǎng)平臺(tái)的數(shù)字化場(chǎng)景向“元宇宙”轉(zhuǎn)型,人類對(duì)數(shù)字內(nèi)容總量和豐富程度的整體需求不斷提高。AIGC作為當(dāng)前新型的內(nèi)容生產(chǎn)方式,已經(jīng)率先在傳媒,電商、影視,娛樂等數(shù)字化程度高,內(nèi)容需求豐富的行業(yè)取得重大創(chuàng)新發(fā)展,市場(chǎng)潛力逐漸顯現(xiàn)。與此同時(shí)在推進(jìn)數(shù)實(shí)融合、加快產(chǎn)業(yè)數(shù)字化轉(zhuǎn)型的進(jìn)程中,金融、醫(yī)療、工業(yè)等各行各業(yè)的AIGC應(yīng)用也都將快速發(fā)展起來。

三、AIGC特點(diǎn)與醫(yī)療場(chǎng)景結(jié)合展望

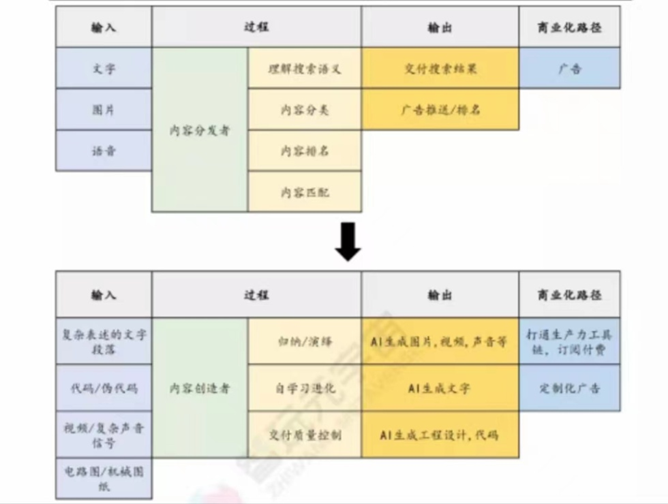

在內(nèi)容消費(fèi)領(lǐng)域,AIGC已經(jīng)重構(gòu)了整個(gè)應(yīng)用生態(tài)。AIGC在內(nèi)容生成領(lǐng)域有以下優(yōu)勢(shì)特征:

1.通用信息抽取技術(shù)UIE(Universal Information Extraction),結(jié)合醫(yī)學(xué)NLP提供通用的后結(jié)構(gòu)化增益:基于Prompt思想,將希望抽取的Schema信息轉(zhuǎn)換成“線索詞”(Schema-based Prompt)作為模型輸入的前綴,使得模型理論上能夠適應(yīng)不同領(lǐng)域和任務(wù)的Schema信息,并按需抽取出“線索詞”指向的結(jié)果,從而實(shí)現(xiàn)開放域環(huán)境下的通用信息抽取。

2.大模型預(yù)訓(xùn)練下自動(dòng)內(nèi)容生成,支持跨模態(tài):基于千億級(jí)大模型并行架構(gòu)下,對(duì)于通用任務(wù)大型語言和圖像Al模型可用于自動(dòng)生成內(nèi)容。

AIGC模型可以生成多種類型的內(nèi)容,包括文本、圖像和音視頻、3D內(nèi)容等等。這可以幫助專業(yè)人士創(chuàng)建多樣化、更有趣的內(nèi)容,從而吸引更廣泛的人群。醫(yī)療領(lǐng)域直接的受益點(diǎn)就是未來患者的“電子病歷”和“電子健康檔案”中的主要醫(yī)療文書,將通過大模型的泛在語義結(jié)合指令微調(diào)小模型的精練語義相融合,而自動(dòng)生成部分核心內(nèi)容,其內(nèi)容也將是文字結(jié)合圖片和視頻甚至部分3D內(nèi)容。圖文并茂的新特性,將極大的豐富病案的可讀性和內(nèi)容的可解釋性。既為未來電子病歷、電子健康檔案的“互聯(lián)互通互認(rèn)”,向患者個(gè)人開放奠定基礎(chǔ),也為基于醫(yī)學(xué)科研與臨床真實(shí)世界的研究提供支撐。

3.降低領(lǐng)域門檻和運(yùn)營(yíng)成本,提高專業(yè)內(nèi)容和管理質(zhì)量:未來領(lǐng)域內(nèi)基于AIGC內(nèi)容制作的門檻和成本將顯著降低、效率也會(huì)顯著提高。行業(yè)專家將可以以更低的成本,和更高的生產(chǎn)速度,創(chuàng)造出有獨(dú)特價(jià)值和獨(dú)立視角的內(nèi)容。而且AIGC生成的內(nèi)容,由于其“AI”的血緣,可能比人類創(chuàng)建的內(nèi)容質(zhì)量更高從而起到良好的智能輔助作用。因?yàn)槿斯ぶ悄苣P湍軌驈拇罅繑?shù)據(jù)中學(xué)習(xí),并識(shí)別出人類顯在的或隱在的管理和控制新邏輯,并把這些邏輯貫穿到內(nèi)容生成中,這將產(chǎn)生出更準(zhǔn)確和信息更豐富的內(nèi)容。以前述的醫(yī)療文書為例,文檔的模板更規(guī)范、質(zhì)控邏輯更清晰、內(nèi)容表達(dá)更豐富、易讀性和可解釋性也更強(qiáng)。而且可以極大地把醫(yī)務(wù)人員從日常繁瑣的文件梳理工作中解放出來,把更多的精力投入到患者醫(yī)療救治服務(wù)和臨床科研中去。

4.可實(shí)現(xiàn)個(gè)性化內(nèi)容服務(wù),聊天機(jī)器人和“數(shù)字人”成為新的、更包容性的用戶交互界面:人工智能模型可以根據(jù)個(gè)人用戶的喜好生成個(gè)性化內(nèi)容。這可以使垂直領(lǐng)域?qū)I(yè)人士,創(chuàng)建出目標(biāo)受眾更感興趣的內(nèi)容,并被廣泛閱讀或分享。未來隨著性能的講一步提升,對(duì)話式AIGC在搜索、知識(shí)傳播等領(lǐng)域有很大的應(yīng)用空間。AIGC的最終目標(biāo)是做一個(gè)類似于新時(shí)代的“搜索引擎”。目前從ChatGPT展示出來的內(nèi)容輸出質(zhì)量和內(nèi)容覆蓋多維度,已經(jīng)可以直面“搜索引擎"與“問答社區(qū)”等相關(guān)應(yīng)用。AIGC支撐了Al驅(qū)動(dòng)未來“數(shù)字人”多模態(tài)交互中的識(shí)別感知和分析決策功能,并使其“高度擬人化”。其中自然語言處理好比是“數(shù)字人”的大腦,“說人話”直接影響受眾的交互體驗(yàn)。而計(jì)算機(jī)視覺ViT決定了“數(shù)字人”面部表情和肢體動(dòng)作的人類情感自然流露。目前主流的方式是圍繞NLP能力通過文本驅(qū)動(dòng),本質(zhì)是通過ASR-NLP-TTS等AI技術(shù)進(jìn)行感知-決策-表達(dá)的閉環(huán)來驅(qū)動(dòng)“數(shù)字人”交互。醫(yī)療可對(duì)接的場(chǎng)景很容易想到未來“12320”熱線的無人值守、數(shù)字家醫(yī)智能患者隨訪、健康評(píng)估、健康咨詢與宣教、遠(yuǎn)程醫(yī)療等需要大量人機(jī)交互的場(chǎng)景和醫(yī)療服務(wù)新模式領(lǐng)域。

5.元宇宙概念提出后,互聯(lián)網(wǎng)下一個(gè)重要方向?qū)摹霸诰€"走向"在場(chǎng)",全面邁向3D互聯(lián)網(wǎng)新時(shí)代,而AIGC將成為打造虛實(shí)集成世界的基石。未來人們將可以在虛擬空間中構(gòu)建仿真世界,在現(xiàn)實(shí)世界“疊加”虛擬增強(qiáng),以實(shí)現(xiàn)逼真的臨場(chǎng)感。隨著各種交互、仿真、傳輸技術(shù)的不斷突破,信息在傳輸層越來越接近無損,如果“算法”、“算力”、“算據(jù)”的整合能力仍可不斷提升,則未來數(shù)字仿真能力將“真假難辨”,而人類在3D互聯(lián)網(wǎng)中的交互和沉浸體驗(yàn)將達(dá)到新高度。如果這一天真的來臨,代表AIGC的能力已經(jīng)擴(kuò)展到從虛擬場(chǎng)景、到虛擬角色、再到虛擬內(nèi)容的全面仿真能力的生成式內(nèi)容全覆蓋。未來的“互聯(lián)網(wǎng)醫(yī)院”的場(chǎng)景也將升級(jí),從現(xiàn)在的“線下”與“線上”的一體化,走向未來“現(xiàn)場(chǎng)”和“在場(chǎng)”的一體化。所謂“在場(chǎng)交易”,“現(xiàn)場(chǎng)交割”的互聯(lián)網(wǎng)診療運(yùn)營(yíng)和服務(wù)新模式的出現(xiàn),使患者不再受到時(shí)空的限制,人人都將可以“分身有術(shù)”。醫(yī)療垂直領(lǐng)域服務(wù)為王、內(nèi)容為王的新時(shí)代也將到來。醫(yī)療服務(wù)供方、需方、監(jiān)管方的三者關(guān)系,將在新一代互聯(lián)網(wǎng)3D空間中以虛擬現(xiàn)實(shí)的方式展開全面的沉浸式體驗(yàn)和內(nèi)容互動(dòng)。

四、AIGC助推元宇宙發(fā)展

未來AIGC將是推動(dòng)元宇宙發(fā)展的重要生產(chǎn)工具:

首先,AIGC為構(gòu)建沉浸式的元宇宙空間環(huán)境提供了核心基礎(chǔ)設(shè)施技術(shù),將成為元宇宙的生產(chǎn)力工具。元宇宙在理論上可以用于工作、會(huì)議、游戲以及生活社交等各種人類活動(dòng),因此需要在元宇宙空間中創(chuàng)建各種各樣的活動(dòng)對(duì)象,建筑和活動(dòng)環(huán)境。但是在過去為了構(gòu)建這些數(shù)字環(huán)境,需要開發(fā)團(tuán)隊(duì)半手工地創(chuàng)建每一個(gè)部分,專業(yè)化門檻高、工作量巨大其成本高企。而現(xiàn)在AIGC已經(jīng)可以實(shí)現(xiàn)創(chuàng)建逼真的3D虛擬空間環(huán)境、虛擬人物,并且效率和成本可以滿足大規(guī)模的元宇宙字間通用環(huán)境的統(tǒng)一創(chuàng)建。AIGC使得新一代數(shù)字化“創(chuàng)世紀(jì)”成為可能。

其次,AIGC將作為生產(chǎn)力工具,為元宇宙用戶提供個(gè)性化內(nèi)容體驗(yàn)。大量個(gè)性化、多元化的數(shù)字內(nèi)容是未來吸引人們?cè)凇霸顚彙敝小傲鬟B忘返”的重要原因。虛擬場(chǎng)景、虛擬角色、虛擬身份、虛擬內(nèi)容的映射、連接和對(duì)齊需要高度智能化的生產(chǎn)工具。而這些內(nèi)容如果僅通過人工方式來生產(chǎn)既成本高又耗時(shí)長(zhǎng),肯定無法滿足用戶的海量需求,因此需要AIGC作為重要生產(chǎn)力工具來滿足助推“元宇宙”的早日到來。

五、結(jié)束語

數(shù)字經(jīng)濟(jì)可能是未來替代石油能源經(jīng)濟(jì)的發(fā)展新方向,目前緊密發(fā)布的相關(guān)文件和機(jī)構(gòu)改革方案,也進(jìn)一步印證了這一點(diǎn)。人工智能作為數(shù)字經(jīng)濟(jì)的“上層建筑”,雖然目前還不是萬能的,但未來如果沒有也是萬萬不能的。“數(shù)字化”說到底其實(shí)就是為了解決結(jié)構(gòu)化和語義化問題;“智能化”就是為了使邏輯和推理變得更加人性化和高度可泛化。AIGC正好同時(shí)契合了這兩個(gè)維度的方向,而且在技術(shù)體系內(nèi)實(shí)現(xiàn)了兩者高度的融合,所以AIGC未來的發(fā)展與垂直行業(yè)相結(jié)合,接了“地氣”后發(fā)展空間將更加不可限量。

格物致知、以物格物、推近致遠(yuǎn),應(yīng)該是我們具備的“科學(xué)態(tài)度”。這篇文章目前還是一種“推演”,而我們文中所述的種種在未來回頭再看,可能早已“一日千里”,僅僅“滄海一粟”而已。當(dāng)然在興奮中之余我們也應(yīng)該清醒的認(rèn)識(shí)到:科技的翅膀往往會(huì)在倫理的海洋里泛起漣漪。但是無論如何,科技向善、科技為人類福祉而奮斗,應(yīng)該是萬變不離其宗的“科學(xué)精神”。

全部商品分類

全部商品分類